As LLMs (como o ChatGPT e Gemini) não funcionam como o Google. Eles sintetizam uma resposta única a partir de múltiplas fontes e citam apenas os conteúdos que conseguem acessar e processar.

O ChatGPT, por exemplo, já processa mais de 2,5 bilhões de prompts por dia e atende mais de 900 milhões de usuários semanais. Além disso, o Gartner projeta que 25% das buscas tradicionais migrarão para plataformas de IA até o final de 2026.

Nesse cenário, o SEO técnico ganha uma nova camada: garantir que crawlers de IA consigam acessar, entender e citar o seu conteúdo. Este guia detalha cada ajuste técnico necessário.

Por que o SEO técnico é a base da visibilidade em LLMs

Mesmo o conteúdo com mais autoridade do mundo não será citado por uma IA se ela não conseguir acessá-lo.

No caso do Googlebot, ele consegue renderizar JavaScript e interpretar elementos carregados depois.

Já os bots de IA leem exclusivamente o HTML estático. Portanto, se o seu site depende de client-side rendering, grande parte do conteúdo pode simplesmente ficar invisível para os modelos de linguagem.

Além disso, em 2026, crawlers de IA já representam uma parcela relevante do tráfego de bots na maioria dos sites. Ainda assim, muitas empresas não revisaram sua estrutura técnica para garantir compatibilidade com esses acessos.

Em outras palavras, produzem conteúdo de qualidade, mas não verificam se ele pode, de fato, ser lido pelas IAs.

Por isso, antes de pensar em estratégias avançadas, é fundamental garantir o básico: que o conteúdo esteja acessível, estruturado e disponível em HTML estático.

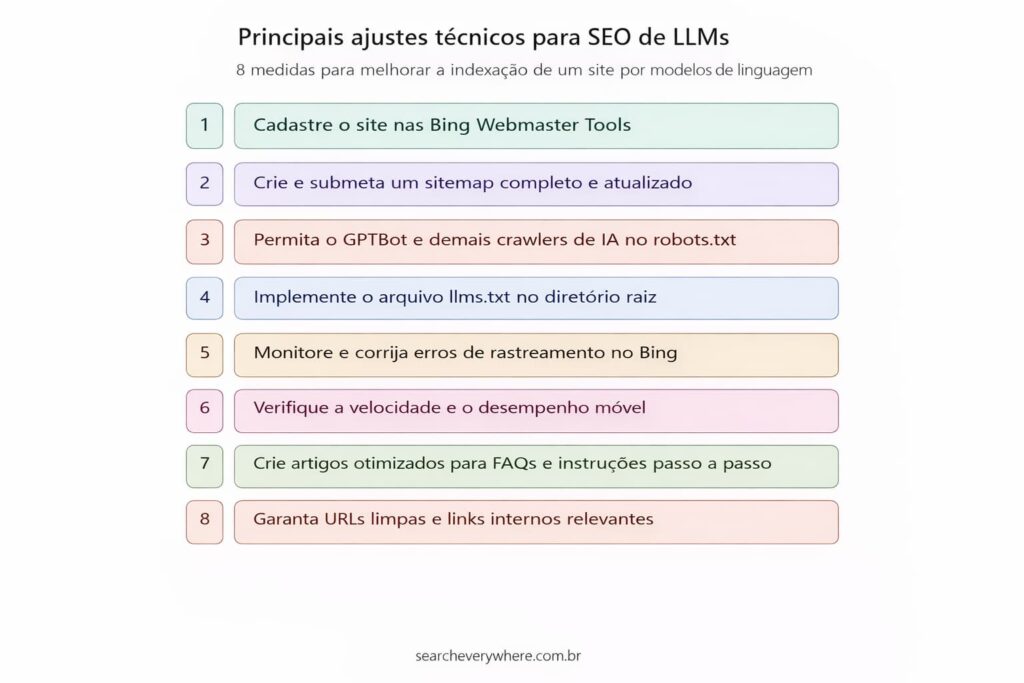

Principais ajustes técnicos para SEO de LLMs

1. Configure o robots.txt para permitir crawlers de IA

O robots.txt funciona em 2026 como um documento de política que determina quais agentes de IA acessam seu conteúdo. O problema é que muitos sites ainda operam com configurações legadas que bloqueiam esses bots sem que a equipe sequer tenha conhecimento.

Por isso, verifique se GPTBot, ClaudeBot, Google-Extended e PerplexityBot estão permitidos. Para se ter uma ideia, entre sites de notícias, 62% bloqueiam o GPTBot e 69% bloqueiam o ClaudeBot.

A recomendação é sempre permitir o acesso. A única exceção são conteúdos sensíveis que você não deseja incorporados ao treinamento dos modelos.

2. Garanta que o conteúdo esteja no HTML estático

Além do robots.txt, outro ponto crítico é a forma como o conteúdo é entregue. Crawlers de IA não executam JavaScript, o que significa que qualquer conteúdo carregado via React, Vue ou Angular sem server-side rendering é completamente invisível.

A solução é implementar SSR ou SSG para que o conteúdo relevante esteja no HTML da primeira resposta. Para testar, acesse seu site com JavaScript desabilitado: se o conteúdo não aparece, os bots de IA também não o veem.

Vale lembrar que conteúdos atrás de abas, acordeões, modais ou paywalls também ficam inacessíveis. Ou seja, nada que deveria ser indexado pode ficar atrás de barreiras que impeçam o acesso direto do crawler.

3. Implemente schema markup (dados estruturados)

Uma vez que o conteúdo está acessível, o próximo passo é facilitar a compreensão dele pelas máquinas. O schema markup fornece contexto legível que informa diretamente se o conteúdo é uma FAQ, um tutorial, uma página de produto ou um artigo.

Nesse sentido, priorize os tipos com maior impacto: FAQPage, HowTo, Product, Article e Organization.

Para garantir que tudo funcione, valide a implementação com o Rich Results Test do Google e o Schema Markup Validator. Erros no schema geram interpretações incorretas, enquanto um schema bem executado transforma sua página em resposta pronta para citação.

4. Cadastre e otimize seu site no Bing Webmaster Tools

Outro ajuste essencial é garantir presença no Bing. O ChatGPT utiliza o índice do Bing para buscas em tempo real, e se o seu site não está indexado lá, ele simplesmente não será considerado nas consultas.

Sendo assim, cadastre seu site no Bing Webmaster Tools, submeta o sitemap XML e corrija erros de rastreamento. Na prática, se o Bing não consegue indexar uma página, o ChatGPT provavelmente não vai citá-la.

Mantenha também o sitemap com datas de última modificação corretas. Isso prioriza o rastreamento de conteúdos recém-atualizados, que ficam disponíveis mais rápido para o ChatGPT.

5. Adote o padrão llms.txt

Complementando o robots.txt e o sitemap, o llms.txt funciona como um “mapa de conteúdo” específico para crawlers de IA. Posicionado na raiz do domínio, ele informa quais páginas são mais importantes e como o conteúdo está organizado.

O padrão ainda está em fase inicial de adoção: apenas cerca de 10% dos domínios o implementaram até agora. Isso representa uma oportunidade concreta de diferenciação para quem adota cedo.

A boa notícia é que a implementação é simples. Basta criar um arquivo na raiz do domínio listando as URLs relevantes com uma breve descrição de cada uma.

6. Estruture o conteúdo em chunks semânticos

Com a parte técnica resolvida, a atenção se volta para a forma como o conteúdo é organizado. LLMs processam textos em chunks: blocos de 75 a 225 palavras que representam uma ideia completa e independente.

Por isso, estruture cada seção sob H2 ou H3 como um chunk autônomo, com resposta direta e dados de suporte. Quanto mais modular e autocontido for cada bloco, maior a probabilidade de o modelo extraí-lo para compor uma resposta.

Além disso, use subtítulos em formato de pergunta. Em vez de “Precificação”, por exemplo, escreva “Quanto custa um software de CRM em 2026?”. Essa estrutura facilita a citação pelo modelo.

7. Otimize velocidade de carregamento e Core Web Vitals

A performance técnica também influencia diretamente a visibilidade em IA. Bots que fazem buscas em tempo real consideram a velocidade do servidor ao decidir quais páginas processar, e páginas com TTFB acima de 600ms perdem oportunidades de rastreamento.

A meta recomendada é um TTFB abaixo de 200ms, alcançável com edge computing, cache agressivo e CDN. Já para o LCP, o ideal é ficar abaixo de 2,5 segundos, servindo imagens em AVIF ou WebP.

Esse impacto é cumulativo: a velocidade influencia o ranqueamento no Bing e Google, que alimentam o ChatGPT.

8. Corrija links internos e elimine conteúdo duplicado

Por fim, a arquitetura de links internos ajuda LLMs a mapear a estrutura temática do site. Clusters bem interligados sinalizam profundidade de expertise, enquanto links quebrados ou páginas órfãs interrompem essa compreensão.

Para evitar confusão, use canonical tags corretamente e garanta que redirecionamentos 301 funcionem para todas as URLs migradas. A revisão de duplicatas é parte essencial de qualquer checklist técnica voltada para LLMs.

Na prática, construa jornadas de conteúdo com sentido semântico. Linke “estratégia de marketing com IA” para “campanhas de email com IA” e depois para “modelos de prompt”. Essa cadeia cria um mapa de conhecimento que os LLMs usam para avaliar a cobertura do site.

Conclusão

Em resumo, o SEO técnico para LLMs é uma evolução natural das práticas que já sustentam o SEO tradicional: rastreabilidade, velocidade, estrutura limpa e sinais de confiança. A diferença são requisitos específicos como HTML estático, robots.txt e chunks semânticos.

Quer dominar cada camada do SEO multicanal? Confira outros conteúdos da Search Everywhere e descubra como garantir que sua marca apareça em qualquer plataforma onde o seu público pesquisa.

Foto destaque: reprodução/ Freepik.